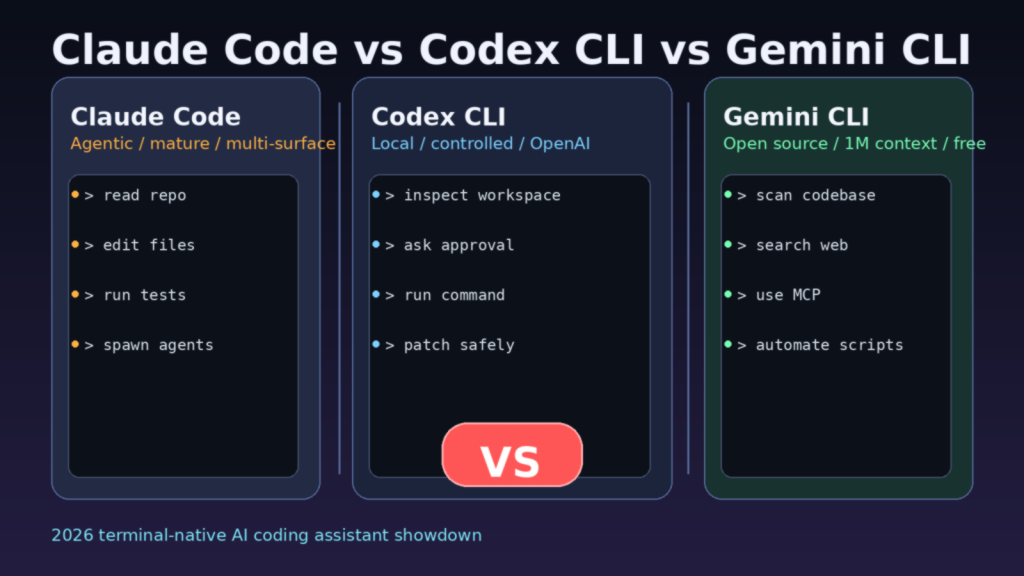

Claude Code vs OpenAI Codex CLI vs Gemini CLI:2026 终端原生 AI 编程助手,谁最像真正的工程搭子?

很多人以为 Claude Code、OpenAI Codex CLI、Gemini CLI 这类工具,真正的差别主要在模型谁更聪明、参数谁更猛。

真用进真实项目后你会发现,决定体验的从来不是“会不会写一段代码”,而是谁能更快进入你的工作流,接住上下文,自己把事情往前推。

这三款工具表面上都在做同一件事:把 AI 带进 terminal,帮你读代码、改文件、跑命令。但把同一个任务扔进去之后,差距会很快放大。

有的像已经入职的工程同事,你说一句,它就知道该先看哪里;有的像边界感极强的执行器,每一步都在提醒你权限和审批;还有的便宜、开放、上下文超大,像一台很能打的改装底盘,潜力很猛,但默认手感还差最后一点。

所以这篇不比谁更会“答题”,只比一件更现实的事:到了 2026 年,谁最像那个能长期一起干活的工程搭子?

TL;DR

如果你懒得看全文,直接看这一版。

- 想要最像工程搭子的综合体验:选 Claude Code

- 想要更强的本地安全边界和 OpenAI 生态衔接:选 OpenAI Codex CLI

- 想要最低门槛、最大免费额度、最长上下文:选 Gemini CLI

- 个人开发者第一次上手 terminal AI agent:Gemini CLI 最友好

- 已经深度用 Claude、愿意付费换成熟度:Claude Code 最稳

- 团队里流程重、审批重、想把 agent 放进现有规范里:Codex CLI 更对味

一张表看完:Claude Code、Codex CLI、Gemini CLI 核心差异

| 维度 | Claude Code | OpenAI Codex CLI | Gemini CLI |

|---|---|---|---|

| 定位 | 成熟的 agentic coding tool | 本地运行的 coding agent | 开源 terminal AI agent |

| 主要形态 | Terminal + IDE + Desktop + Web + Mobile/Remote | Terminal + IDE + App + Web 协同 | Terminal 为主,和 Gemini Code Assist 打通 |

| 代码操作 | 读代码、改文件、跑命令、Git、PR、hooks | 读改运行本地代码,强调审批与 sandbox | 文件操作、shell、web fetch/search、自动化 |

| 上下文机制 | 整库理解 + CLAUDE.md + auto memory |

本地目录上下文 + 配置/审批策略 | 1M token 本地 codebase awareness + GEMINI.md |

| 扩展能力 | MCP、skills、hooks、subagents、plugins | sandbox / approvals / CLI feature set,偏工具化 | MCP、extensions、checkpointing、trusted folders |

| Agent 能力 | 多 agent 协作、scheduled tasks、channels、remote control | coding agent 明确,但更强调可控执行 | ReAct loop + MCP,偏“开放工作台” |

| 价格/门槛 | Claude Pro 月付 $20 起,Max $100 起 | 可并入 ChatGPT Plus/Pro/Business/Edu/Enterprise | 免费额度很大,个人账号可用 |

| 开源 | 核心产品闭源,生态可扩展 | CLI 开源 | CLI 开源(Apache 2.0) |

| 最适合 | 愿意为成熟度买单的重度开发者 | OpenAI 生态用户、重审批流程团队 | 预算敏感、喜欢折腾、想先低成本入门的人 |

先把三者说人话:它们到底分别像谁

如果把这三款工具拟人化,差别其实很好懂。

Claude Code 像一个已经带过几个项目的 senior engineer。你跟它说“先看代码,再给方案,改完自己跑测试”,它大概率知道这事该怎么走。

Codex CLI 像一个流程意识很强的工程同事。它不是不干活,而是特别在意“这一步该不该批准、这个命令是不是越界、这个 sandbox 够不够安全”。

Gemini CLI 像一个便宜、好养、脑容量很大、工具箱也挺全的新搭子。你会感觉它没有 Claude Code 那么“产品成品味”,但很适合搭自己的玩法。

问题就在这里。

真正的“工程搭子”,不只是会补代码,而是要在理解项目、动手执行、出错自救、跨工具协作这四件事上都够像人。

从这个标准看,2026 年这三家已经不是“谁能写一段代码”的比赛了,而是在比:谁更像一个能长期一起干活的工程伙伴。

1. 终端体验:Claude Code 最完整,Codex CLI 最克制,Gemini CLI 最轻快

Claude Code:不只是 terminal,好在它不是只给你一个 terminal

Anthropic 官方文档对 Claude Code 的定义很直接:它是一个 agentic coding tool,能读代码库、编辑文件、运行命令,还能接 development tools,而且不只活在 terminal 里,也活在 IDE、desktop、browser 里。

这点很关键。

很多 CLI 工具的问题不是“不能用”,而是你用到第二周就开始烦:

- terminal 里能干,图形界面不好 review diff

- 手机上看不到进度

- 想远程接手本地 session 很别扭

- 一个任务跑很久,中途不好切场景

Claude Code 在 2025-2026 这一轮把这些都补得比较完整:

- terminal 是主战场

- VS Code / JetBrains 有原生接法

- desktop 能做可视化 diff review 和多 session

- web 端能跑异步任务

- remote control / channels 让它不再被桌面绑死

所以它给人的感觉更像“一个完整工作台”,而不是“一个能在 shell 里打字的模型”。

OpenAI Codex CLI:本地感更强,产品气质更像“受控执行器”

OpenAI 对 Codex CLI 的官方说法是:它是一个在本地 terminal 里运行的 coding agent,能在所选目录里读取、修改、运行代码。 官方 README 也明确写了,CLI 开源、核心强调本地运行。

这套设计的好处很明确:

- 更容易理解它到底能碰什么

- 更容易跟本地 repo、shell、现有工具链对上

- 更容易塞进已有工程流程

但它的产品气质和 Claude Code 明显不一样。

从 OpenAI 开发者文档公开出来的配置和安全说明看,Codex CLI 对 approval policy 和 sandbox mode 非常重视。默认语境不是“你把活交给我我来搞定”,而是“我可以帮你干,但每一步权限边界要先说清楚”。

这种风格对很多团队是优点。

但如果你问“谁更像一个放在旁边一起干活的搭子”,Codex CLI 的主观体感会更像:一个本地 agent 执行器,而不是一个已经进入协作状态的工程伙伴。

Gemini CLI:轻、快、便宜,像 2026 年最容易上手的 agent shell

Gemini CLI 的官方定位也很清楚:一个开源 AI agent,把 Gemini 直接带进 terminal。

它的第一印象不是“成熟得吓人”,而是“这个东西真不贵,而且配置完就能上手”。

Google 给它做对了三件事:

- 个人 Google 账号就能登录

- 免费额度足够大,不像试玩版

- CLI 本身开源,文档和扩展逻辑也更透明

如果你是第一次认真用 terminal-native AI agent,Gemini CLI 很可能是最容易形成正反馈的那个。因为你不会一上来就被成本吓退。

2. 上下文理解:Gemini CLI 参数最猛,Claude Code 体验最成熟,Codex CLI 更像“按目录做事”

Claude Code:强项不是单纯 token,而是“长期工作语境”

Anthropic 这条路的核心,不只是大模型本身会写代码,而是他们把 memory、skills、hooks、subagents、MCP 全部做成了工程协作的一部分。

尤其是 CLAUDE.md 和 auto memory 这个组合,很像把“团队开发约定”和“项目经验”长期留在 agent 身边。

这会直接影响体感。

有些工具也能看大上下文,但看完像没入职;Claude Code 更像是会慢慢知道:

- 你们项目偏什么架构

- 哪些命令是常用 build / test 命令

- 这个 repo 有哪些雷区

- 哪套 review checklist 该默认执行

这种“不是只理解代码,而是理解工作方法”的感觉,才是它像工程搭子的原因。

Gemini CLI:1M token 很凶,是真的凶

Gemini CLI / Gemini Code Assist 官方文档给出的数字很直接:

- local codebase awareness:1,000,000 token context window

- 免费个人版配额可到 60 requests/min、1000 requests/day

先说结论:这个组合非常有杀伤力。

大上下文不自动等于更懂项目,但它至少让 Gemini CLI 在“大仓库快速扫读”和“跨目录串联理解”这件事上,天然比很多轻量 CLI 更敢吃上下文。

再加上 GEMINI.md、checkpointing、trusted folders 这些配置项,它其实已经具备搭一套长期工作流的底子。

问题在于,Gemini CLI 给人的成熟度更像“一个开放底盘”,不是已经把默认工作方式打磨到极致的成品。你想玩得舒服,通常要自己调得更多。

Codex CLI:不是不懂上下文,而是它更像“在当前工作目录里谨慎做事”

Codex CLI 当然也不是只会单文件补全。OpenAI 官方文档已经把它定义成 coding agent,而且能本地读、改、跑代码。

但从公开文档和产品描述看,它当前最鲜明的特征不是“上下文有多大”,而是本地执行、审批策略、sandbox、和 ChatGPT / Codex 体系的衔接。

换句话说,Codex CLI 的强项更偏:

- 在本地项目里办事

- 在可控边界里办事

- 跟 OpenAI 自家产品栈衔接得更顺

如果你更关心“它是不是能像一个长期懂我项目习惯的工程同事”,Claude Code 现在会更像;如果你更关心“它是不是能在我批准的范围里稳定办事”,Codex CLI 的设计就更对味。

3. 代码编辑和执行:Claude Code 最像会自己推进,Codex CLI 最强调边界,Gemini CLI 在中间

真正拉开差距的,不是会不会改文件,而是敢不敢把改、跑、修、再跑这一整串闭环做掉。

Claude Code:把“做完整件事”当默认

Claude Code 官方文档里写得很明确:

- 能写功能、修 bug

- 能跑命令

- 能直接跟 git 打通,处理 commit / branch / PR

- 能接 CI / GitHub Actions / GitLab CI/CD

- 能用 hooks 自动做格式化、lint、校验

这意味着它的思维模型不是“我帮你写一段代码”,而是“我把这件开发任务往前推”。

这就是为什么很多开发者会觉得它不像 chatbot,反而更像一个真的会做事的搭子。

Codex CLI:本地执行明确,但默认心态是先把护栏立起来

OpenAI 官方的 Codex CLI README 和开发者文档都强调一件事:它是本地 coding agent,而且它确实能读、改、运行代码。

但从 approval / sandbox 这一套来看,它更像是把“安全和可控”放在第一优先级。

这并不一定更差。

如果你在公司环境里,或者 repo 很敏感,反而会更喜欢这种风格。因为它不会天然给你一种“随便放权吧,我都能处理”的幻觉。

只是站在“工程搭子”这个题目下,我会说它更像:

一个很能干、但你得先把权限条款跟它写清楚的同事。

Gemini CLI:工具箱挺全,自动化潜力很大

Gemini CLI 官方文档和 README 已经给了不少明牌:

- file operations

- shell commands

- web fetch

- web search / Google Search grounding

- MCP servers

- 非交互脚本模式

- checkpointing

这套能力其实已经足够让它做很多“从理解到执行”的完整任务。

而且它和 Gemini Code Assist agent mode 共享技术底层,这一点也挺重要。说明 Google 不是只想做个 terminal 小玩具,而是在把 CLI 和 IDE agent 一起推进。

如果你愿意自己搭 workflow,它的潜力不小。

但默认开箱即用的“工程搭子感”,我还是会把 Claude Code 放前面。

4. Agent 能力:Claude Code 明显跑在前面,Gemini CLI 有开放潜力,Codex CLI 更偏单 agent 实干派

Claude Code:subagents、hooks、skills、channels 这一套太像完整操作系统了

光看 Claude Code 文档目录,你就能感觉到它不是只想做一个 CLI。

它已经把下面这些拼起来了:

- subagents / agent teams

- skills

- hooks

- MCP

- scheduled tasks

- remote control

- channels

- desktop / web / mobile continuation

这背后的含义不是“功能很多”,而是它已经开始从“coding assistant”往“developer operating layer”走。

说白了,Claude Code 不只是帮你写代码,它在试图占住“开发工作流入口”。

这也是为什么它最像工程搭子。因为真正的搭子不是只会接一句 prompt,而是能在你离开电脑的时候继续推进任务,能在你回来时把结果接上。

Gemini CLI:ReAct + MCP,像一块很好改装的开放底盘

Google 官方文档直接写了,Gemini CLI 用的是 ReAct loop,而且支持 local / remote MCP servers。

这句很值钱。

因为它说明 Gemini CLI 不只是命令行版对话框,而是有明确 agent 结构的。

再加上:

- 自定义

GEMINI.md - extensions

- GitHub Action

- 非交互脚本调用

- trusted folders / sandboxing

它更像一个适合自己搭工作流的开源 agent 平台。

我甚至会说,如果你是喜欢自己改 CLI、写扩展、拼 MCP 的那类开发者,Gemini CLI 的乐趣可能比 Claude Code 还大。

但“自由度高”和“像成熟搭子”不是一回事。前者更像玩改装车,后者更像提车就能跑长途。

Codex CLI:更像把 agent 收敛进本地执行链路

Codex CLI 的 agent 感当然存在,不然 OpenAI 也不会直接叫它 coding agent。

但从目前公开信息看,它最突出的卖点仍然是:

- 本地运行

- 与 ChatGPT / Codex 产品栈衔接

- approval / sandbox / config 管理

- IDE / app / web 互相配合

它不像 Claude Code 那样,已经把 subagent、hooks、channels 这类“更像协作系统”的能力摆到台面上成为主叙事。

所以如果你问“谁更像一个完整的 agentic engineering coworker”,Codex CLI 目前还没赢到这一步。

5. 定价和可用性:Gemini CLI 最狠,Claude Code 最贵但最成熟,Codex CLI 最看你是不是 OpenAI 生态用户

Claude Code:付费门槛不低,但成熟度也确实高

Anthropic 官方价格页显示:

- Claude Pro 月付 $20 起

- Claude Max 月付 $100 起

- Pro 已经包含 Claude Code

这意味着 Claude Code 不是那种“随便试着玩一周”的工具,它更适合已经确认自己会长期用的人。

问题是,它也确实给出了相对完整的成熟产品体验。你花的钱,不只是模型费,也是“少折腾”的钱。

Codex CLI:如果你本来就在 ChatGPT 体系里,门槛没想象中高

OpenAI 官方 Codex 定价页的搜索结果片段已经明确写到:Codex 已包含在 ChatGPT Plus、Pro、Business、Edu、Enterprise 计划里。

这件事很关键。

因为很多人会误以为 Codex CLI 代表又一份单独订阅。未必。

如果你本来就是 ChatGPT Plus / Pro 用户,它的边际门槛反而可能不高。那 Codex CLI 的吸引力就会明显上升。

Gemini CLI:免费策略非常激进

Google 在官方博客和文档里给的免费条件非常狠:

- 个人 Google 账号可用

- 60 requests/min

- 1000 requests/day

- 1M token context window

这不是那种“送你几次体验一下”的免费,而是已经够很多独立开发者认真用起来。

所以如果你问我,哪家最像 2026 年的“市场破坏者”,不是 Claude,也不是 OpenAI,而是 Gemini CLI。

它可能不是最成熟,但它最容易把更多开发者拉进来。

6. 适合人群:别问谁最强,先问你自己是哪种开发者

适合 Claude Code 的人

你更适合 Claude Code,如果你符合下面三条中的两条以上:

- 你愿意为成熟体验付费

- 你想要的不只是 terminal,而是一整套跨 terminal / IDE / desktop / web 的连续工作流

- 你希望 agent 不只是写代码,而是能接 hooks、MCP、subagents、scheduled tasks

- 你在意“搭子感”胜过“配置乐趣”

适合 OpenAI Codex CLI 的人

你更适合 Codex CLI,如果你本身就在 OpenAI 体系里,而且更在意这几件事:

- 本地运行的确定性

- approval / sandbox 的清晰边界

- 和 ChatGPT / Codex / IDE 的衔接

- 团队对安全流程和审批要求更高

它不是最花哨,但可能是最容易塞进你现有规范里的那个。

适合 Gemini CLI 的人

你更适合 Gemini CLI,如果你符合这些画像:

- 想先低成本甚至接近零成本上手

- 预算敏感,但不想玩阉割版

- 喜欢开源工具,可接受自己多调一些配置

- 想要很大的上下文窗口

- 想自己拼 MCP、extensions、脚本工作流

对很多独立开发者来说,Gemini CLI 可能是 2026 年最容易形成“高性价比依赖”的 CLI agent。

那谁最像真正的工程搭子?

还是回到标题。

如果把“真正的工程搭子”定义成:

- 不是只能答题

- 能理解整个项目

- 能自己推进任务闭环

- 能跟你的工具链长期协作

- 能跨场景接续工作

那我现在的排序是:

- Claude Code

- OpenAI Codex CLI

- Gemini CLI

但这里有个反直觉的地方。

Gemini CLI 不一定比 Codex CLI 弱,只是它更像一台你自己调校出来的车。 如果你愿意折腾,它完全可能在你的个人工作流里跑得非常猛。

而 Codex CLI 的问题也不是能力不够,而是它现在更像“可控 agent 工具”,还没完全长成“默认就像同事一样协作”的感觉。

Claude Code 则是目前最接近“你把需求交给它,它知道该先看什么、改什么、跑什么、怎么把事情收尾”的那个。

这就是“工程搭子感”的本质差别。

不是哪个模型更会说,而是谁更像已经进入你的工程现场。

我的建议:2026 年最现实的选法

如果你是个人开发者,我会这么建议:

- 预算充足,直接要成品体验:Claude Code

- 已经订了 ChatGPT Plus / Pro,想试本地 agent:Codex CLI

- 还在探索阶段,想低成本认真用起来:Gemini CLI

如果你是小团队,我会这么看:

- 要统一工作流、强调成熟度:Claude Code

- 要更清晰的本地执行边界和审批文化:Codex CLI

- 要控制成本、又愿意自己搭配工作流:Gemini CLI

真没必要神化任何一家。

这三家现在都已经不是“会不会写代码”的问题,而是在争夺同一个位置:谁会成为开发者默认带在身边的 AI 伙伴。

截至 2026 年这一刻,Claude Code 站位最领先。

但 Gemini CLI 追得很凶,Codex CLI 也绝不会只是陪跑。

接下来这一年,真正好看的,不是模型榜,而是谁先把 AI 从“会聊天”彻底拉成“会长期协作”。

FAQ

Claude Code、Codex CLI、Gemini CLI 都是本地跑吗?

不完全一样。三者都能在 terminal 里工作,也都强调和本地代码目录配合;但 Claude Code 的产品形态最广,不只在 terminal,也覆盖 IDE、desktop、web 和远程接续。Codex CLI 更强调本地执行目录和审批边界。Gemini CLI 则是 terminal-first 的开源 agent。

哪个最便宜?

如果按入门成本看,Gemini CLI 最便宜,而且免费额度非常大。Claude Code 的订阅门槛更高。Codex CLI 则取决于你是不是已经在用 ChatGPT Plus / Pro 等计划。

哪个更适合大代码库?

如果只看公开参数,Gemini CLI 的 1M token context window 很有优势;如果看“长期协作的实际体感”,Claude Code 目前更成熟。一个是参数猛,一个是工作流更像真的同事。

哪个更适合公司团队?

看你团队文化。如果你们想要更成熟的 agent 工作流,Claude Code 更合适;如果你们特别强调审批、sandbox 和边界感,Codex CLI 会更顺手。

2026 年第一次上手 terminal AI coding assistant,该选哪个?

如果你还没形成稳定偏好,Gemini CLI 最适合先上手。因为便宜、额度大、上手阻力低。用出感觉后,再决定是否切到 Claude Code 或 Codex CLI。

资料来源(官方优先)

- Anthropic Claude Code Docs: Overview / Skills / Hooks / Subagents / Remote Control / Channels / Pricing

- OpenAI Codex CLI README 与 OpenAI Developers 文档片段(CLI / Pricing / Agent approvals & security)

- Google Developers: Gemini CLI / Quotas and limits

- Google Blog: Gemini CLI 发布说明

相关阅读

CLI 工具之外,GUI IDE 这边的选择也在快速分化。Cursor、Windsurf、Copilot 三者的差异和适用场景,可以看这篇:Cursor vs Windsurf vs Copilot:2026 AI 编程 IDE 怎么选。